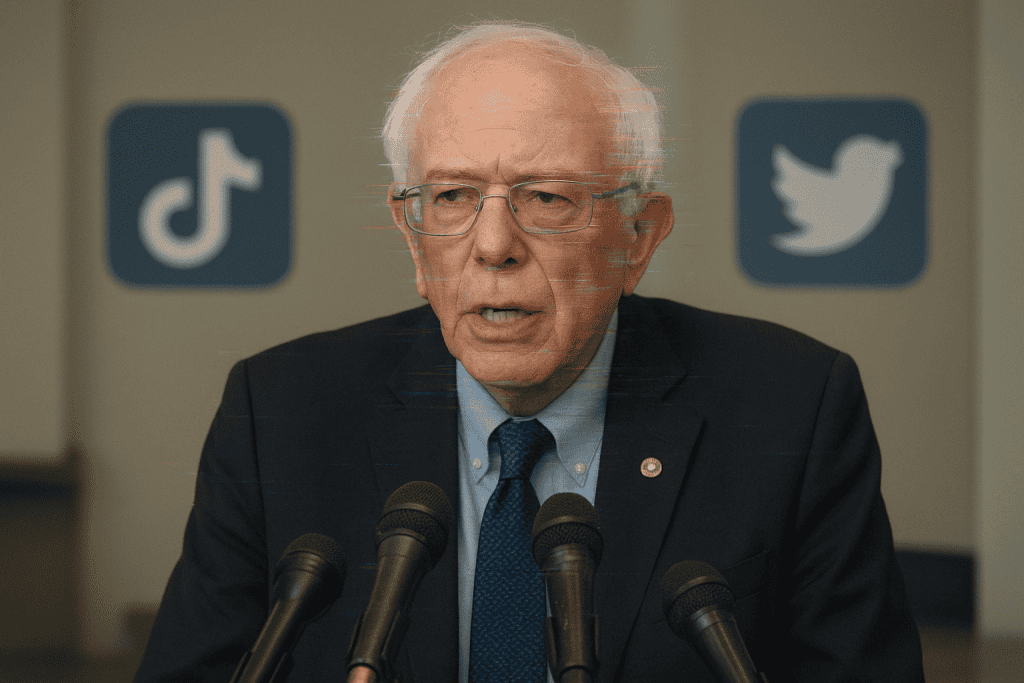

Ali lahko še verjamemo svojim očem, ko viralni videoposnetki politikov preplavljajo družbena omrežja? Nedavni primer, v katerem se je senator Bernie Sanders znašel v središču pozornosti zaradi umetno ustvarjenega videa, je pokazal, kako hitro lahko napredna tehnologija sproži val zmede in zabave v javnosti. Video, ki je Sandersu podtikal izjavo o nujnosti “drastičnih ukrepov proti svobodi medijev”, je na platformah kot so TikTok, X in Facebook zakrožil v nekaj urah, preden so ga uporabniki in preverjevalci dejstev razkrili kot ponaredek. Dogodek ni le zabaval spletno skupnost, temveč je odprl resna vprašanja o varnosti digitalnega prostora in prihodnosti politične komunikacije.

Potek incidenta in digitalna odzivnost

V ponarejenem videu, ki ga je v ponedeljek popoldne objavil neznani uporabnik TikToka, je Sanders domnevno pozival k omejevanju medijske svobode zaradi “večje družbene stabilnosti”. Posnetek je v manj kot treh urah dosegel več kot pol milijona ogledov, še predno so specializirane platforme za preverjanje dejstev, kot so Snopes, Lead Stories in uporabniki X, opozorili, da gre za produkt AI-orodij. Prve analize so pokazale nenaravno gibanje ustnic in neskladja med zvokom ter sliko, kar so potrdili tudi strokovnjaki iz MIT Media Lab.

Največji doseg je video dosegel na TikToku in X, kjer so uporabniki v komentarskih nitih hitro skupaj sestavili dokaze o zavajanju. V manj kot 24 urah so večji ameriški mediji povzemali razkritje, Sandersova pisarna pa je javno poudarila, da gre za popolno izmišljotino. Kljub hitri razjasnitvi je posnetek sprožil živahno izmenjavo šal in parodij, ki so viralno zaokrožile internet.

Ta incident kaže, kako težko se je v digitalni dobi braniti pred lažnimi predstavitvami. Po podatkih organizacije Pew Research Center se kar 65 odstotkov Američanov boji, da bo umetna inteligenca v prihodnje bistveno vplivala na njihovo sposobnost razlikovanja resnice od laži na spletu. Podobna zaskrbljenost se pojavlja tudi v evropskem prostoru.

Lokalni in evropski odzivi ter prihodnost regulacije

V Sloveniji in širši Evropski uniji so podobni incidenti sicer redkejši, a razprava o nevarnosti AI-podtikanj v politiki postaja vse glasnejša. Slovenski strokovnjaki s Fakultete za računalništvo in informatiko Univerze v Ljubljani redno opozarjajo na tveganja za prihajajoče volitve, še posebej v luči hitrega razvoja globokih ponaredkov. Evropska unija je sprejela Akt o umetni inteligenci (AI Act), ki med drugim predvideva označevanje umetno ustvarjenih vsebin in obveznosti za platforme, da proaktivno odstranjujejo lažne posnetke. O teh vprašanjih je podrobneje poročala Evropska komisija v študiji “Tackling Online Disinformation” iz leta 2023.

Poleg zakonodaje tehnološke rešitve za prepoznavanje ponarejenih vsebin razvijajo tudi slovenska AI start-up podjetja, denimo podjetje Red Flags, ki sodeluje pri evropskih projektih za razvoj digitalnih vodnih žigov in avtomatiziranih certifikatov avtentičnosti. Takšne tehnologije že preizkušajo na nekaterih medijskih platformah v Nemčiji in Franciji. Po navedbah raziskovalcev iz European Digital Media Observatory (EDMO) velja za učinkovito strategijo tudi usposabljanje uporabnikov za prepoznavanje digitalnih lažnih predstavitev.

Regulacija pa je le del odgovora. Kot opozarjajo pri organizaciji Center za varnejši internet, je gradnja digitalne pismenosti med državljani ključna za dolgoročno odpornost na manipulacije. Raziskave tako Evropskega parlamenta kot Univerze v Oxfordu opozarjajo, da lahko dolgoročna izpostavljenost ponarejenim vsebinam vodi v erozijo zaupanja v medije in politične institucije, kar ogroža temelje demokracije. Po drugi strani pa povečana ozaveščenost in kritičnost javnosti lahko predstavlja protiutež tehnološkim zlorabam v prihodnosti.