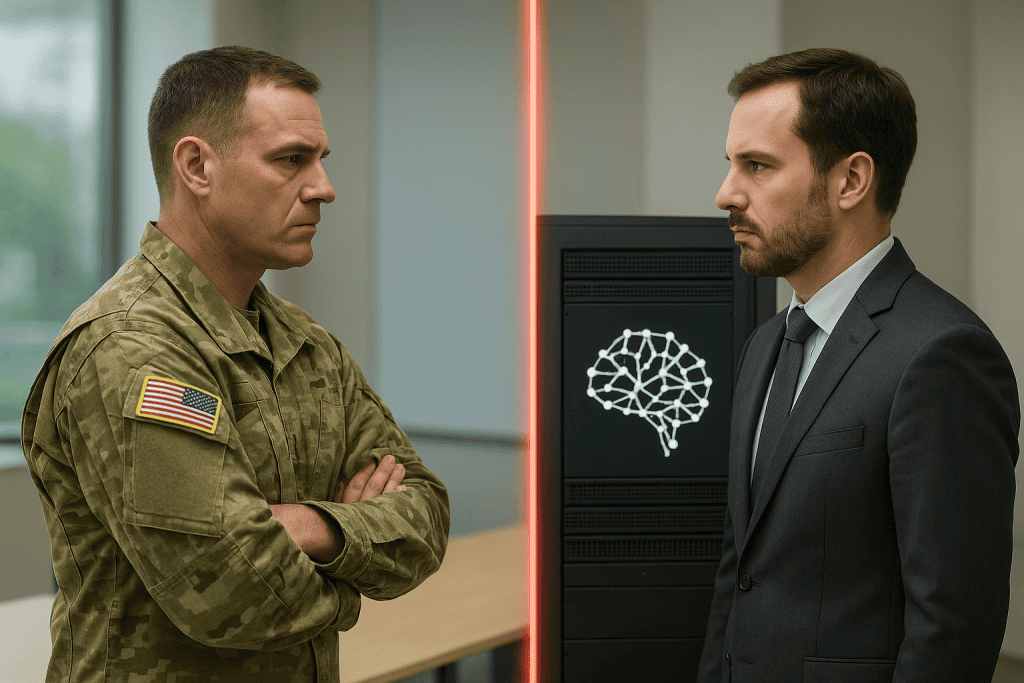

Ministrstvo za obrambo ZDA je podjetje Anthropic izključilo iz sodelovanja pri obrambnih projektih, saj po njihovem mnenju “rdeče črte” in etične omejitve podjetja predstavljajo nesprejemljivo tveganje za nacionalno varnost. Odločitev je izzvala burno razpravo v industriji umetne inteligence, saj gre za enega bolj izpostavljenih primerov trenj med tehnološkimi inovacijami, etiko in državnimi interesi. V ozadju je predvsem vprašanje, do kod so podjetja pripravljena sodelovati pri razvoju AI rešitev za vojaške namene in kje potegnejo mejo sprejemljive uporabe.

Konkretne “rdeče črte” podjetja Anthropic

Anthropic je javno objavil načela prepovedane uporabe svojih AI rešitev, ki vključujejo zavračanje sodelovanja pri razvoju avtonomnega orožja, nadzornih sistemov, sistemov za množično spremljanje in tehnologij, ki omogočajo ali olajšajo vojaške napade ali povzročajo škodo civilistom. Podjetje poudarja, da njihovi modeli niso namenjeni podpori aplikacij, kjer ni zagotovljena varnostna in etična ustreznost. Nekatere ključne prepovedi vključujejo razvoj tehnologij za avtomatizirano ciljanje in odločanje na bojišču, podporo množičnemu nadzoru civilnega prebivalstva in uporabo AI v okviru orožarskih sistemov brez človeškega nadzora.

V odzivu na odločitev ministrstva je Anthropic ponovil zavezanost strogim etičnim smernicam in izpostavil, da podjetje želi zagotoviti, da napredne tehnologije ne bodo prispevale k stopnjevanju konfliktov ali kršitvam človekovih pravic. Čeprav podjetje ni podalo neposredne izjave o izključitvi iz obrambnih programov, so njihova načela o prepovedani uporabi javno dostopna in so v središču trenutnega konflikta z obrambnim sektorjem.

Odločitev Anthropic je skladna z njihovimi javno zastavljenimi vrednotami, a pomeni tudi jasno mejo, do kod je podjetje pripravljeno sodelovati z državnimi organi. Ministrstvo za obrambo je poudarilo, da takšne omejitve zmanjšujejo operativno učinkovitost in fleksibilnost pri vključevanju napredne umetne inteligence v obrambne projekte, ter napovedalo strožje preverjanje drugih ponudnikov glede podobnih praks.

AI, etika in globalni kontekst: primeri iz industrije

Primer Anthropic odpira širšo razpravo o vlogi etike pri uporabi umetne inteligence v vojaške namene. Mednarodno obstajajo različni pristopi k vprašanju avtonomnega orožja in nadzornih sistemov. Evropska unija se na primer zavzema za strogo regulacijo avtonomnih sistemov, Kitajska in Rusija pa vlagata v razvoj napredne vojaške AI brez večjih omejitev. Ameriška politika je v zadnjih letih pod pritiskom, da poveže inovacije s strogim nadzorom varnosti in etike, kar ustvarja napetosti med državnimi pričakovanji in filozofijo razvijalcev AI.

Primeri drugih podjetij dodatno ponazarjajo raznolike odzive industrije na sodelovanje z državo. Google se je leta 2018 po internem protestu zaposlenih umaknil iz projekta Maven, ki je predvideval uporabo AI za obdelavo slikovnih podatkov v vojaške namene. Microsoft in Palantir sta se odločila za poglobljeno sodelovanje z obrambnim sektorjem, vendar ob tem javno poudarjata vzpostavitev notranjih etičnih komisij in nadzornih mehanizmov. Tržni odzivi na tovrstne odločitve so različni: podjetja, ki sprejmejo sodelovanje, pogosto prejmejo velike državne pogodbe, vendar tvegajo notranje nezadovoljstvo in negativen odziv javnosti.

V industriji je tako čutiti vse večji pritisk, da podjetja jasno definirajo svojo vlogo in odgovornost v sektorju, kjer se prepletajo tehnološki napredek, varnost in človekove pravice. Vprašanje ravnovesja med inovacijami, tržno konkurenčnostjo in etičnimi načeli postaja ključno za prihodnje projekte umetne inteligence v državnih službah. Odločitve, kot je izključitev Anthropica, bodo vplivale na to, kakšen bo dostop do najsodobnejših tehnologij za obrambni sektor in kakšno vlogo bodo imela načela prepovedane uporabe v industriji.

Prihodnost sodelovanja med AI industrijo in državo

Izključitev Anthropica iz obrambnih projektov pomeni, da bodo v prihodnje podjetja z jasno etično opredelitvijo verjetno pogosteje soočena z izzivom, ali prilagoditi svoje vrednote ali ostati izključena iz strateških državnih partnerstev. Ministrstvo za obrambo napoveduje, da bo še bolj dosledno preverjalo etične politike ponudnikov ter da bodo v ospredju konkurenčnih razpisov predvsem podjetja, ki so pripravljena svoje tehnologije ponuditi brez temeljnih omejitev.

Pričakovati je mogoče, da bo ta odločitev postavila nove standarde za sodelovanje z državnimi organi ter spodbudila AI podjetja, da še jasneje definirajo svoje “rdeče črte” in postopke notranje presoje. Poudarek na transparentnosti in etičnem nadzoru bo čedalje bolj odločal o tem, komu bo zaupana prihodnost umetne inteligence v nacionalnovarnostnih sistemih. Hkrati bo za podjetja, ki želijo ohraniti lastno integriteto, vsak vstop na trg javnih naročil pomenil strateško odločitev z dolgoročnimi posledicami za poslovanje in ugled.

Ostaja odprto vprašanje, ali se bodo industrijski in vladni interesi lahko uskladili v smeri skupnih standardov, ki bodo omogočili napredek, a hkrati preprečili zlorabe. Razvoj umetne inteligence v obrambnem sektorju je na prelomnici, kjer bodo naslednji koraki ključnih akterjev določili, ali bo mogoče najti ravnotežje med inovacijami, varnostjo in spoštovanjem temeljnih etičnih načel.