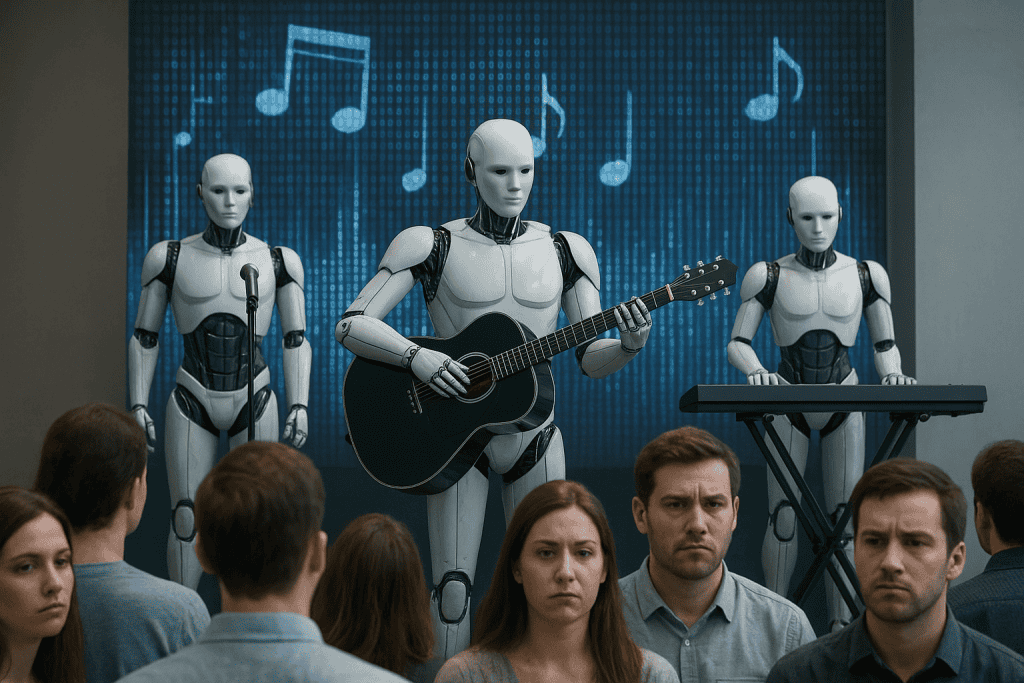

V zadnjih letih je umetna inteligenca postala pomemben igralec v glasbeni industriji, njen vpliv pa se kaže v vse večjem številu projektov, kjer so pesmi ustvarjene popolnoma ali delno s pomočjo umetne inteligence. Primer pesmi Heart on My Sleeve, ki sta jo lani ustvarila uporabnika z vzdevkoma ghostwriter in ai_drake, je izzval burne odzive javnosti in profesionalcev, predvsem zaradi uporabe AI-generiranih vokalov, ki sta posnemala znane izvajalce. Takšni dogodki sprožajo vprašanja ne le o kakovosti in pristnosti glasbe, temveč tudi o prihodnji vlogi umetne inteligence pri ustvarjanju umetnosti.

Negativni odzivi na AI glasbo in tehnične pomanjkljivosti

Pesem Heart on My Sleeve je po objavi na platformah, kot sta YouTube in TikTok, hitro postala viralna, a hkrati sprožila tudi številne negativne odzive. Poslušalci so v komentarjih množično opozarjali na pomanjkanje izvirnosti in čustvene pristnosti. Na YouTube je pesem zbrala več kot 30 odstotkov negativnih odzivov, številni komentarji pa so pesem opisali kot “hladno imitacijo brez duše” ali “digitalno kopijo brez občutka”. Uporabniki družbenih omrežij so pogosto izpostavili občutek, da lahko trenutni AI modeli poustvarijo zvok, ne pa tudi avtentične izkušnje, ki jo ponuja živa izvedba.

Analizirani modeli, ki so bili uporabljeni za ustvarjanje takšnih pesmi, temeljijo na naprednih sistemih kot so OpenAI Jukebox ali orodja za sintezo glasu na osnovi globokega učenja. Te tehnologije delujejo tako, da analizirajo ogromne količine obstoječih pesmi in poskušajo prepoznati vzorce v melodijah, harmonijah in besedilih. Kljub tej sofisticiranosti pa AI pogosto pogreši pri ustvarjanju nepredvidljivih čustvenih prehodov, drobnih intonacij in spontanih odločitev, ki so značilne za človeške izvajalce. Predvsem pri generiranju vokalov poslušalci pogosto zaznajo nenaravne premike v glasovih ali ponavljanje melodijskih vzorcev.

Preteklost ponuja tudi pozitivne primere, kot je AI pesem Daddy’s Car, ki jo je leta 2016 razvila skupina umetnikov z uporabo Sonyjevega sistema Flow Machines. Pesem je bila sprejeta kot zanimiv eksperiment in pohvaljena za kompleksno zvočno strukturo, vendar je bila razlika v sprejemu očitna prav zaradi načina predstavitve: pri Daddy’s Car je bila AI uporabljena zgolj kot orodje, končno besedilo in aranžma pa so oblikovali ljudje.

Kje AI glasba (še) zaostaja in prihodnje priložnosti

Glavni razlogi za negativne odzive na AI glasbo izvirajo iz tehničnih omejitev trenutnih algoritmov. Modeli za generiranje glasbe sicer izjemno dobro obvladajo ponavljanje naučenih vzorcev, a so hkrati omejeni pri ustvarjanju resnično novih in neponovljivih trenutkov. Človeška ustvarjalnost izhaja iz življenjskih izkušenj, spontanih odzivov in subtilnih čustev, kar umetna inteligenca še ne zna učinkovito poustvariti. Pri generiranju besedil AI pogosto sestavlja verze s pomočjo statističnih pravil in ne intuitivnega občutka.

Strokovnjaki vidijo prihodnost AI v glasbi predvsem v sodelovanju med človekom in umetno inteligenco. Glasbeniki lahko uporabijo AI kot orodje za razvijanje novih idej in eksperimentiranje z zvokom, končni rezultat pa oblikujejo z lastno interpretacijo in občutkom. Na ta način lahko AI poveča produktivnost in omogoči ustvarjanje glasbe, ki bi bila sicer preveč zamudna ali tehnično zahtevna, a še vedno ohrani človeški pečat.

Prihodnji razvoj AI glasbe bo moral vključiti izboljšave na področju generiranja naravne intonacije, razumevanja konteksta in personalizacije izkušenj. Raziskovalci iščejo načine, kako bi AI algoritmi lahko vključili večplastno razumevanje čustev in bolj subtilno modulacijo glasu. Ključna bo tudi transparentnost glede avtorstva in etična vprašanja, kot so avtorske pravice ter pravično plačilo za umetnike, katerih dela so uporabljena za učenje modelov. Glasbena industrija tako vstopa v obdobje, kjer bo balansiranje med tehnologijo in človeško ustvarjalnostjo ključnega pomena za dolgoročni uspeh.