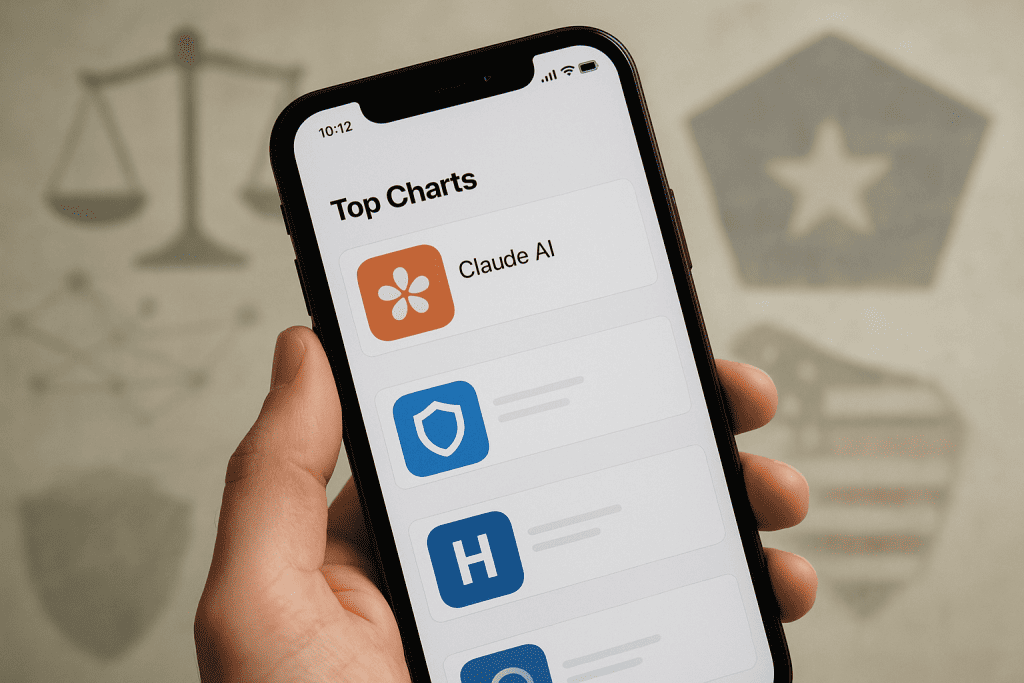

Claude AI podjetja Anthropic je v zadnjem tednu dosegel izjemen preboj na drugem mestu najbolj priljubljenih aplikacij v App Store. Ta uspeh je neposredno povezan z odmevnim razhodom podjetja z ameriškim Pentagonom, ki je izpostavil temeljna vprašanja o etiki in odgovornosti umetne inteligence. Dogajanje odpira pomembna vprašanja glede vrednot, po katerih se tehnološka podjetja usmerjajo v obdobju pospešenega razvoja umetne inteligence, ter kaže na preusmerjanje uporabniške pozornosti k bolj transparentnim in varnostno usmerjenim rešitvam.

Etika, razhajanja in pomen spora s Pentagonom

Do spora med Anthropicom in Pentagonom je prišlo zaradi nesoglasij glede uporabe umetne inteligence v vojaških rešitvah. Anthropic je izpostavil strogo zavezanost načelom odgovorne umetne inteligence, kot sta varnost in preprečevanje zlorab. V središču razhajanj so bila vprašanja o tem, ali lahko sodelovanje z vojaškimi institucijami vodi do razvoja AI, ki bi bila uporabljena za cilje, ki niso v skladu z načeli podjetja. Za Anthropic je bila meja prestopljena, ko so zaznali, da bi njihova tehnologija lahko prispevala k aplikacijam, ki ne zagotavljajo popolne preglednosti in bi lahko pomenile tveganje za civilno družbo.

Spor je sprožil razpravo o tem, kakšne odgovornosti nosijo tehnološka podjetja pri implementaciji naprednih AI rešitev. Medtem ko nekatera podjetja vstopajo v partnerstva z vladnimi ali vojaškimi organi, se je Anthropic odločil, da v ospredje postavi etične standarde, tudi na račun odpovedi donosnim pogodbenim sodelovanjem. To postavlja podjetje na zemljevid tistih, ki se zavestno odločajo za bolj premišljeno tehnološko prihodnost.

Z dogajanjem so se okrepile debate v skupnosti umetne inteligence o tem, ali so etični okvirji dovolj trdni in ali je transparentnost res ključni kriterij za dolgoročno zaupanje v AI. Vse več uporabnikov podpira podjetja, ki zagovarjajo jasno določene vrednote in se v primeru neskladij tudi javno opredelijo.

Posebnosti Claude AI in širše posledice za industrijo

Claude AI se med konkurenti razlikuje po doslednem umeščanju varnosti in transparentnosti v samo jedro produktne zasnove. V primerjavi z rešitvami kot so ChatGPT in Google Gemini, Claude uporabnikom ponuja bolj pregledne vpoglede v delovanje modela in mehanizme za preprečevanje neprimernih ali zavajajočih odgovorov. Eden izmed primerov je možnost vpogleda v razloge za posamezne odgovore ter opozorila glede občutljivih tem, kar daje uporabnikom večji občutek nadzora.

Drugo mesto v App Store je za aplikacijo izjemen dosežek, saj se je še pred sporom s Pentagonom uvrščala med deset najpriljubljenejših AI aplikacij, a ni posegla v sam vrh. Takšen vzpon med vodilne aplikacije na tem področju je redek in ga doslej beležijo le nekatera druga velika AI orodja ob lansiranju ali ob večjih nadgradnjah. Dinamika na trgu kaže, da so preboji v sam vrh App Store med AI aplikacijami izjemno redki in pogosto povezani z večjimi prelomnimi dogodki ali novostmi v industriji.

Uspeh Claude AI ima dolgoročne implikacije tako za podjetje kot za celotno industrijo. Analitiki ugotavljajo, da bo dogodek najverjetneje okrepil trend po večji previdnosti v sodelovanju med razvojnimi podjetji in državnimi organi. Anthropic se v očeh javnosti vse bolj utrjuje kot branilec etičnih praks in transparentnosti, kar lahko dolgoročno poveča zaupanje med uporabniki in okrepi njegov položaj kot zaupanja vreden igralec v svetu umetne inteligence.