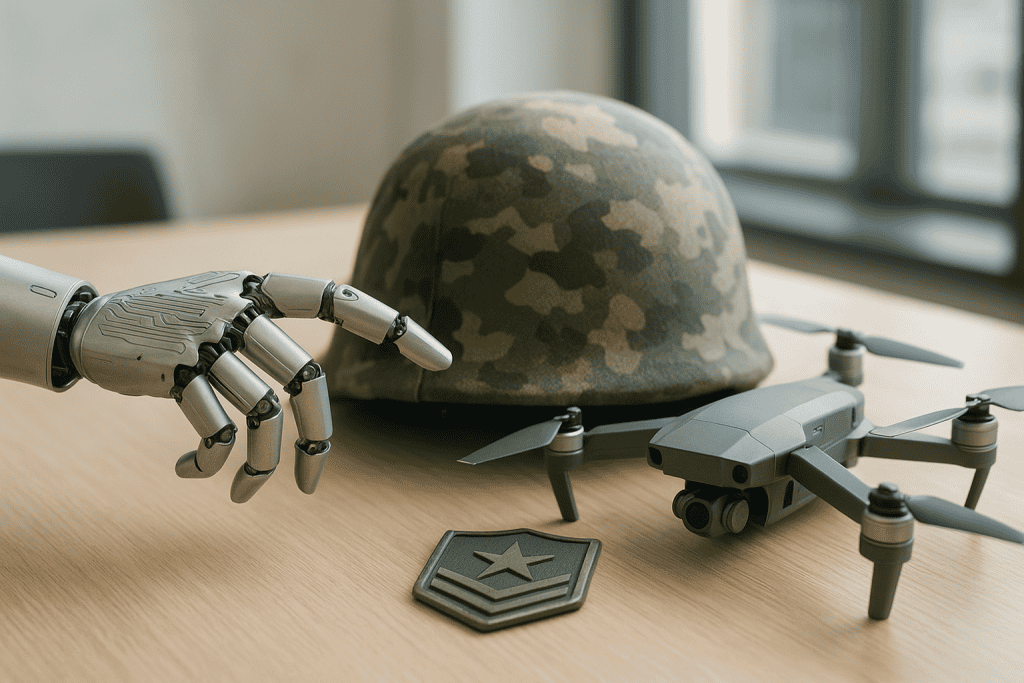

Nad sodelovanjem tehnoloških podjetij z vojsko visi vprašanje, ali umetna inteligenca spreminja ravnotežje moči in morale v sodobnem svetu. Ko AI ni več zgolj orodje produktivnosti, temveč lahko postane del orožja ali sistema nadzora, je jasno, da se svetovna tehnološka industrija sooča z globokimi etičnimi dilemami in pritiski. Rast investicij v AI v obrambnem sektorju sproža razprave med zagovorniki nacionalne varnosti in tistimi, ki svarijo pred tveganji avtonomnih sistemov.

Primeri partnerstev in spori v tehnološkem sektorju

Nekaj najbolj odmevnih primerov sodelovanja tehnoloških podjetij z vojsko je razkrilo, kako razdeljena so stališča znotraj industrije in družbe. Google se je leta 2018 znašel v središču burne razprave, ko je sodeloval v Pentagonovem projektu Maven, ki je umetno inteligenco uporabil za prepoznavanje objektov na posnetkih z dronov. Notranji upor zaposlenih in odmev v javnosti sta prisilila podjetje, da pogodbo ni podaljšalo, kar je postalo precedens za kasnejšo politiko podjetja glede AI v vojaških aplikacijah.

Palantir je znan po tesnem sodelovanju z vladnimi institucijami in vojsko, zlasti v analitiki podatkov. Podjetje je postalo ključen partner ameriškega obrambnega sektorja, vendar je ob tem pogosto tarča kritik zaradi netransparentnosti in potencialnih zlorab podatkov pri nadzoru. Microsoft je leta 2019 prejel milijardno pogodbo za razvoj AR očal za ameriško vojsko, kar je sprožilo proteste številnih zaposlenih, ki so opozorili na etične pasti uporabe komercialne tehnologije za vojaške namene.

Vsi ti primeri kažejo, da so tehnološka podjetja v konfliktu med dobičkom in odgovornostjo. Zaposleni se vse pogosteje oglašajo in zahtevajo javne razprave ter jasna pravila sodelovanja z državo. Protiutež predstavljajo argumenti zagovornikov sodelovanja, ki izpostavljajo pomen napredka in nacionalne varnosti ter potrebo po inovacijah v varnostnih sektorjih.

Etične dileme, regulativni odzivi in prihodnji izzivi

Glavni etični izzivi uporabe umetne inteligence v vojaških projektih so povezani z razvojem avtonomnih orožij, nadzornimi sistemi in vprašanjem odgovornosti za odločitve strojev. Posebej sporni so t. i. sistemi LAWS (Lethal Autonomous Weapon Systems), kjer stroji lahko samostojno izbirajo tarče in sprožijo napad. Organizacije za človekove pravice in številni etiki svarijo, da bi takšna uporaba tehnologije lahko vodila do nepredvidljivih posledic in zmanjšala možnost nadzora nad oboroženimi spopadi.

Na ravni EU so v pripravi predpisi, ki zahtevajo večjo preglednost in oceno tveganj pri razvoju AI, medtem ko so Združeni narodi sprožili pobudo za mednarodno prepoved ali strogo regulacijo avtonomnih orožij. V poročilu think-tanka SIPRI iz leta 2023 je navedeno, da so investicije v AI v obrambnem sektorju v zadnjih petih letih presegle 50 milijard dolarjev, kar potrjuje hitro rast in pomen tega področja.

Zagovorniki vojaške uporabe AI poudarjajo, da lahko napredni sistemi omogočijo boljšo zaščito civilistov in povečajo učinkovitost humanitarnih misij. Nasprotniki opozarjajo, da razvoj orožij in nadzornih sistemov z AI povečuje tveganje za zlorabe, nadzor populacije in poruši že tako krhke mednarodne dogovore o oboroževanju. Tehnološki giganti se tako znajdejo v vlogi, kjer niso več le inovatorji, temveč tudi ključni akterji v razpravah o prihodnosti vojne in miru.

Ravnanje podjetij danes bo oblikovalo normative za prihodnja desetletja. Soočenje tehnološke moči in etične odgovornosti bo zahtevno ter od vseh vpletenih terja odprt dialog, transparentnost in odločnost pri postavljanju jasnih meja. Odločitve v tej fazi bodo zaznamovale vlogo umetne inteligence v svetu prihodnosti, kjer bo vprašanje njene uporabe v vojaške namene ostalo v središču družbenih, tehnoloških in političnih razprav.