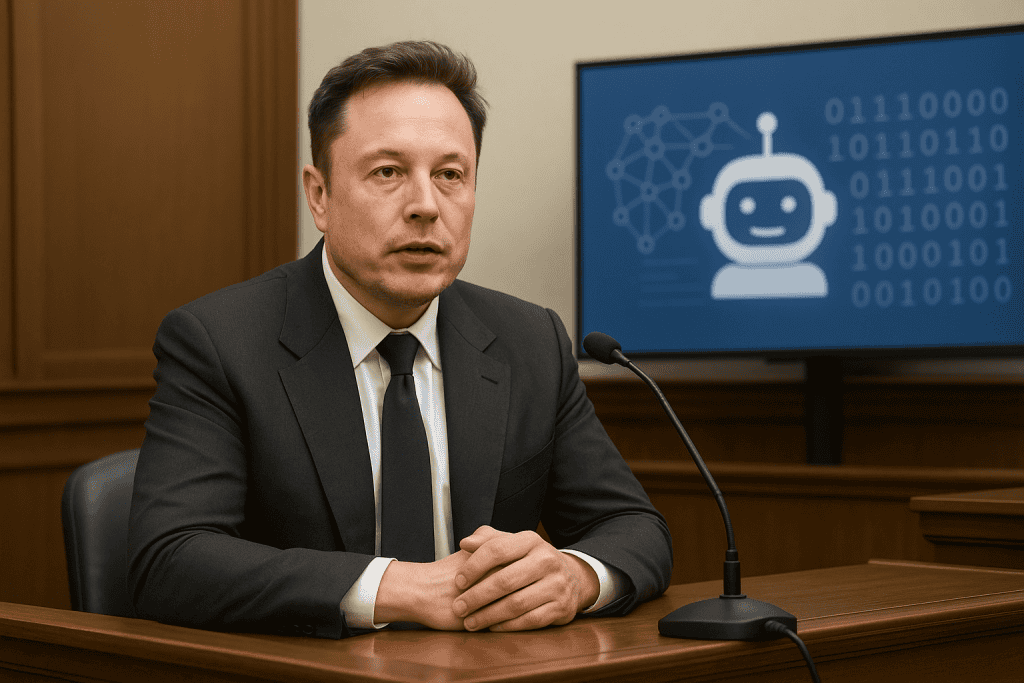

V sodnem postopku, v katerem Elon Musk toži podjetje OpenAI zaradi domnevnih kršitev ustanovne pogodbe in odmaknitve od prvotno dogovorjenih načel odprtosti, je Musk v vlogo tožnika in priče pred newyorškim sodiščem predstavil več ključnih trditev. Njegovo pričanje je v ospredje postavilo vprašanja o odgovornosti razvijalcev umetne inteligence, transparentnosti delovanja AI podjetij in vplivu naprednih jezikovnih modelov na uporabnike. Posebej je izpostavil razliko med sistemom Grok, ki ga razvija njegovo podjetje xAI, in rešitvami, ki jih ponuja OpenAI, ter kritiziral smer razvoja največjega konkurenta.

Muskove trditve in konkretne kritike na račun OpenAI

Med pričanjem je Elon Musk poudaril, da po njegovih informacijah ni znanih primerov samomorov zaradi uporabe AI sistema Grok. S tem se je odzval na medijska poročila in razprave v strokovni javnosti, ki so v preteklosti povezovale določene napredne jezikovne modele s škodljivimi vplivi na duševno zdravje posameznikov. Musk je poudaril, da Grok uporablja pristop odprte kode in napredne varnostne filtre, ki naj bi preprečevali neželene ali nevarne interakcije z uporabniki. Omenil je tudi, da je Grok zaradi svoje omejene razširjenosti in razmeroma kratkega časa na trgu statistično težko primerljiv z obsežnejšimi sistemi, kot je ChatGPT.

Musk je v sodni dvorani izpostavil kritiko na račun OpenAI zaradi njihovega zapiranja podatkov, postopkov razvoja in komercializacije modelov. Po njegovih besedah se je OpenAI odmaknil od izvorne filozofije odprtosti in dostopnosti tehnologij. Kritiziral je odločitve o nerazkritju ključnih informacij o modelih in o omejevanju javnega vpogleda v delovanje ter napajanje modelov z neznanimi viri podatkov. Predvsem pa ga moti, da OpenAI ni podvržen neodvisnemu nadzoru in da so njihovi modeli pogosto zaprte narave, kar po njegovem mnenju povečuje tveganja za uporabnike.

Ob tem je Musk pozval k vzpostavitvi jasnih regulacijskih okvirov in večji transparentnosti v industriji umetne inteligence. Izpostavil je dileme, kot so odgovornost podjetij za posledice uporabe AI, potrebo po varovalih pred zlorabami in zahtevo po neodvisnem nadzoru nad razvojem. Sodni postopek je tako še dodatno osvetlil vprašanja o tem, kako naj regulativni organi in širša javnost nadzorujejo podjetja, ki razvijajo visoko zmogljive umetne inteligence s potencialno daljnosežnimi vplivi.

Odzivi in širši vpliv na industrijo umetne inteligence

OpenAI se je na Muskove trditve v sodnem postopku odzval z zavrnitvijo očitkov, da bi bil njihov način razvoja škodljiv ali netransparenten. Podjetje poudarja, da so njihovi varnostni protokoli in notranje etične smernice prilagojene najnovejšim standardom industrije in da so zavezani nenehnemu izboljševanju varnosti uporabnikov. Hkrati so izpostavili, da so kakršnekoli povezave med njihovimi rešitvami in škodljivimi posledicami za uporabnike, vključno z duševnim zdravjem, doslej ostale neodvisno nepotrjene.

Strokovnjaki s področja etike umetne inteligence in predstavniki regulativnih organov poudarjajo, da so trditve o vplivu naprednih AI modelov na psihološko počutje uporabnikov težko preverljive in zahtevajo poglobljene, neodvisne raziskave. Po mnenju neodvisnih analitikov so sodni postopki, kot je ta med Muskom in OpenAI, pomembni za vzpostavljanje precedensov na področju odgovornosti razvijalcev in upravljalcev umetne inteligence. Nekateri v tem dogodku vidijo priložnost za javno razpravo o potrebnih spremembah regulacije in okrepitvi neodvisnega nadzora nad industrijo.

Incident v ameriškem sodnem sistemu vpliva na širšo globalno razpravo o etiki, varnosti in regulaciji umetne inteligence. Primer izpostavlja ključne dileme industrije: kako uravnotežiti inovacije s potrebno zaščito uporabnikov, kako zagotoviti transparentnost razvoja in kaj pomeni odgovorno ravnanje v praksi. Kritike in pričanja vplivnih posameznikov, kot je Musk, tako prispevajo k oblikovanju prihodnjih pravil igre na področju umetne inteligence ter krepijo pritisk na podjetja, naj spoštujejo najvišje standarde odgovornosti in varnosti.