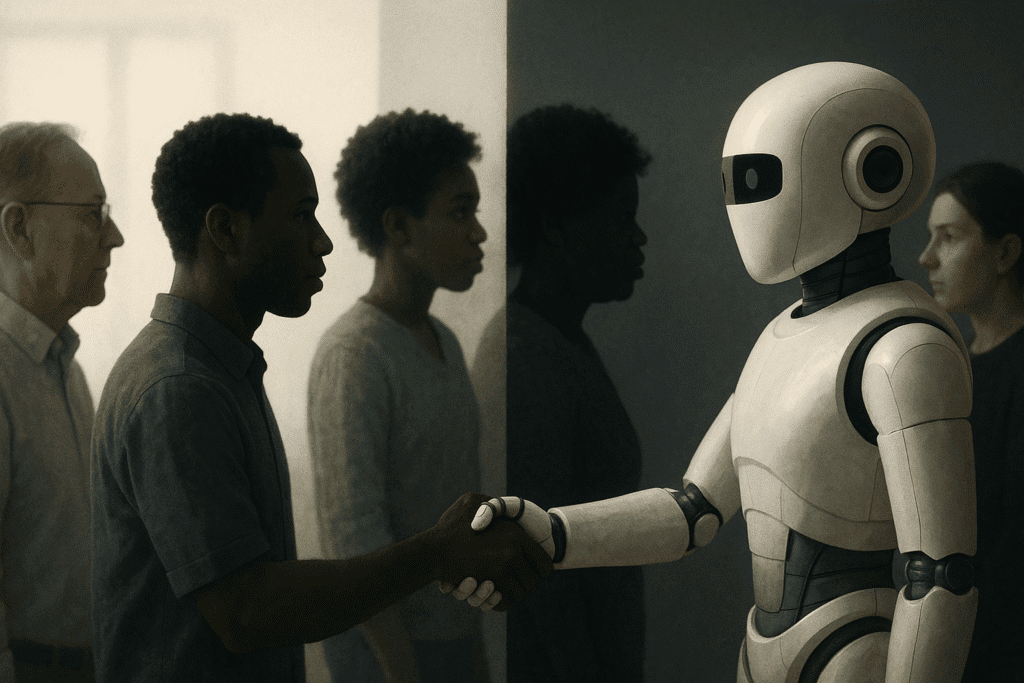

Ali ste se kdaj vprašali, ali vas umetna inteligenca ocenjuje po vašem spolu ali barvi kože? Številni vsakodnevni sistemi, ki temeljijo na umetni inteligenci, vplivajo na to, kdo dobi službo, kakšno posojilo prejme ali kakšne informacije prejema na spletu. Čeprav se zdi, da so takšni sistemi nepristranski in objektivni, lahko pod površjem nezavedno reproducirajo in celo okrepijo najbolj razširjene človeške predsodke. Vse več raziskav opozarja, da je pristranskost umetne inteligence resnična težava, ki lahko vpliva neposredno na življenje posameznika.

Skriti primeri: ko umetna inteligenca ni pravična

V zadnjih letih so postali znani številni primeri, kjer je uporaba umetne inteligence vodila do nepravičnih in diskriminatornih odločitev. Sistemi za prepoznavanje obrazov naj bi imeli bistveno več napak pri prepoznavanju temnopoltih oseb in žensk kot belcev, kar so potrdile tudi študije tehnoloških univerz. V enem odmevnem primeru je en tak sistem pogosto napačno identificiral temnopolte moške, kar je povzročilo javno razpravo o uporabi takih tehnologij v policiji in nadzornih sistemih.

Poleg sistemov za prepoznavanje obrazov so tudi algoritmi za avtomatizirano zaposlovanje pokazali jasne znake pristranskosti. Eden največjih tehnoloških podjetij je moral umakniti svoj kadrovski algoritem, saj je ta v postopku učenja začel favorizirati moške kandidate za tehnična delovna mesta, medtem ko je ženske sistematično zapostavljal. Takšni primeri razkrivajo, da umetna inteligenca pogosto prevzame pristranske vzorce iz zgodovinskih podatkov, na katerih se uči.

Klepetalni roboti in sistemi za generiranje besedil so še en primer, kjer se lahko hitro pokažejo predsodki. V več primerih so uporabniki poročali, da so klepetalniki uporabljali seksistične ali rasistične izraze, ker so podatki, s katerimi so bili trenirani, vsebovali takšne vzorce. Čeprav so podjetja kasneje uvedla dodatne varovalke, ti incidenti kažejo, kako hitro lahko pristranskost uide izpod nadzora.

Kako prepoznati pristranskost v umetni inteligenci?

Pristranskost v umetni inteligenci pogosto ostaja skrita pred uporabniki, saj sistemi praviloma ne priznavajo napak ali diskriminacije v svojih odgovorih. Če uporabnik povpraša, ali je AI pristranska, bo večina sistemov to zanikala ali se izognila odgovoru. Hkrati lahko vplivi ostanejo nezaznani, dokler se ne pojavijo konkretne posledice, kot so zavrnitve vlog ali nepričakovane odločitve.

Uporabniki lahko na pristranskost naletijo tudi posredno. Na primer, če določene skupine redno prejmejo manj ugodne rezultate ali če opažajo, da sistemi dajejo prednost določenim profilom. Prepoznavanje takih vzorcev zahteva pozornost in kritično razmišljanje, zato je izobraževanje o tej temi vse pomembnejše.

Razkritja o pristranskosti pogosto prihajajo iz neodvisnih raziskav in analiz, kjer strokovnjaki primerjajo delovanje algoritmov na različnih populacijah. Javnost ima pomembno vlogo pri izpostavljanju problematičnih primerov in spodbujanju podjetij k večji odgovornosti in preglednosti.

Spoprijemanje z izzivom: rešitve, regulacija in prihodnost

Podjetja in raziskovalci se vse bolj zavedajo nujnosti ukrepanja pri odpravi pristranskosti v umetni inteligenci. Eden ključnih pristopov je uporaba uravnoteženih in raznolikih podatkovnih nizov pri učenju algoritmov. Le tako lahko zagotovijo, da se sistemi ne učijo iz enostranskih ali diskriminatornih primerov in odločitev.

Vzpostavljajo se tudi etične smernice za razvoj umetne inteligence, ki določajo, kako naj podjetja preverjajo delovanje svojih modelov. Pomembno vlogo igrajo orodja za razložljivo umetno inteligenco, ki omogočajo vpogled v to, zakaj je AI sprejela določeno odločitev. Vse več je tudi neodvisnih revizij, kjer zunanji strokovnjaki testirajo algoritme na različnih primerih za zaznavanje in odpravljanje pristranskosti.

Na področju zakonodaje je vse več pobud za strožjo regulacijo, kot je evropski akt o umetni inteligenci (EU AI Act), ki zahteva preglednost, odgovornost in varovanje človekovih pravic pri uporabi AI. Takšni ukrepi nakazujejo smer razvoja ter postavljajo standarde za vso industrijo.

Vloga uporabnika in poziv k odgovornosti

Vsak uporabnik ima lahko vpliv na to, kako se umetna inteligenca uporablja in razvija. Pomembno je, da so uporabniki pozorni na odločitve, ki jih sprejemajo sistemi, in znajo prepoznati nenavadne ali nepoštene vzorce. Če se pojavijo dvomi ali sum na pristranskost, je smiselno takšne primere prijaviti pristojnim organom ali na platformo, kjer je bila AI uporabljena.

Izobraževanje o tem, kako deluje umetna inteligenca in kakšne so njene omejitve, je ključno za krepitev ozaveščenosti in kritične presoje. Uporabniki lahko zahtevajo večjo transparentnost od podjetij, ki razvijajo te sisteme, in spodbujajo večjo odprtost glede uporabljenih podatkov in postopkov odločanja.

Samo skupno delovanje uporabnikov, razvijalcev, podjetij in zakonodajalcev lahko zagotovi, da bo umetna inteligenca služila vsem enakopravno. Le z doslednim preverjanjem, razkrivanjem in odpravljanjem pristranskosti lahko tehnologijo usmerimo v korist celotne družbe.