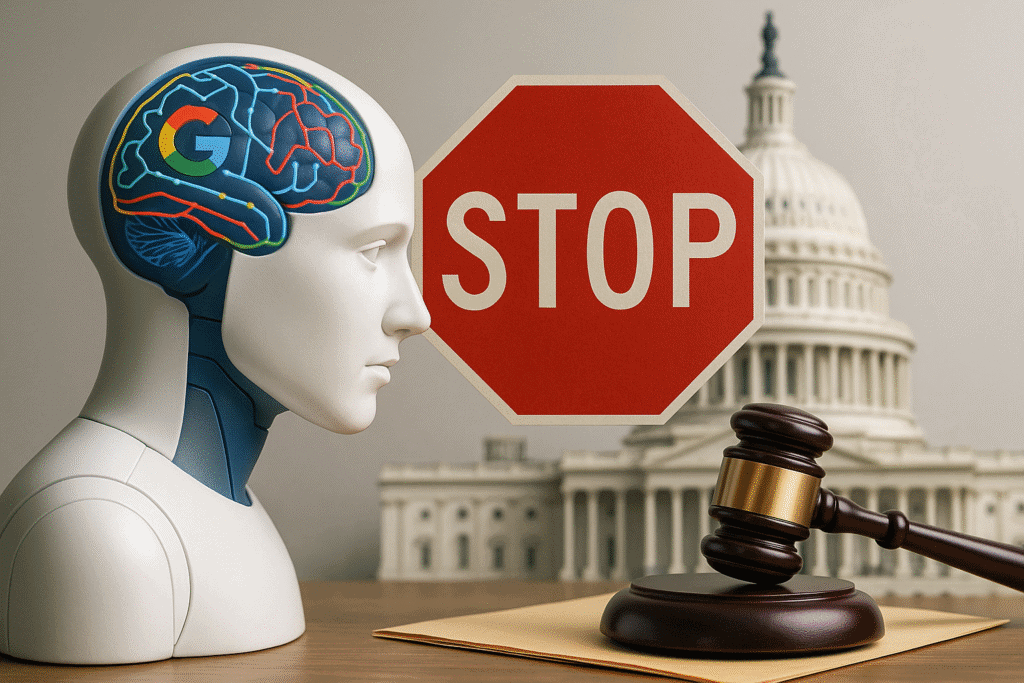

Google je nepričakovano umaknil svoj model umetne inteligence Gemma iz platforme AI Studio, potem ko je senatorica Marsha Blackburn družbo obtožila, da model ustvarja obrekljive vsebine o njej. Incident je sprožil val odzivov v tehnološki industriji in zaskrbljenost glede prihodnjega razvoja ter regulacije velikih jezikovnih modelov. Po podatkih, ki jih je objavil TechCrunch, se Google na izredne očitke odziva z dodatnimi varnostnimi pregledi in začasno ustavitvijo dostopa do modela za uporabnike.

Googlov odziv in posledice za razvijalce

Google je v uradni izjavi za več ameriških medijev, med njimi tudi TechCrunch in The Verge, potrdil, da je model Gemma umaknil iz AI Studio “zaradi notranjih varnostnih pregledov, ki sledijo pomislekom glede generiranih vsebin.” Podjetje ni napovedalo, kdaj bo model ponovno na voljo, a poudarja, da jim je varnost uporabnikov in preprečevanje zlorab na prvem mestu. Podjetje je obljubilo okrepitev moderacije in dodatna izobraževanja svojih modelov, kar naj bi zmanjšalo možnost zlorab v prihodnje.

Za razvijalce, ki so Gemmo uporabljali za razvoj aplikacij, prototipov ali raziskave, je bila nenadna odstranitev modela iz AI Studio nepričakovana ovira. Mnogi so se morali preusmeriti na alternative, kot so odprtokodni modeli (npr. Llama 2) ali druge Googlove rešitve. V razvojni skupnosti je najti tudi pomisleke glede zanesljivosti velikih ponudnikov AI in opozorila, da so takšne prekinitve lahko velik izziv za večje projekte, ki temeljijo na določenem modelu. Nekateri razvijalci so na forumih, kot je Hacker News, izrazili skrb, da bi lahko podobni incidenti v prihodnje vplivali na hitrost inovacij in zaupanje v tovrstne platforme.

Industrijski analitiki, kot so iz Gartner in Forrester, menijo, da se bo zaradi takšnih dogodkov vse več podjetij odločalo za hibridni pristop, kjer bodo kritične aplikacije temeljile na modelih, ki jih nadzorujejo sami. Tako naj bi se zmanjšal vpliv zunanjih odločitev ponudnikov umetne inteligence na poslovanje razvijalcev.

Širši kontekst, prihodnje smernice in pogled iz Slovenije

Odstranitev Gemme prihaja nekaj mesecev po tem, ko je Google doživel množico kritik zaradi pristranskosti in netočnosti pri svojem modelu Gemini. Tudi drugi tehnološki velikani, kot sta Meta s svojim modelom Llama in OpenAI z GPT, so se v preteklosti že znašli pod drobnogledom zaradi nepredvidenih odzivov modelov. Incident z Gemmo kaže, da se bodo podjetja v prihodnje bolj zanašala na strožje varnostne ukrepe in omejitve, kar bi lahko vplivalo na odprtost in inovativnost AI orodij.

Regulacija umetne inteligence v ZDA in Evropi postaja vse pomembnejša tema, pri čemer primer Gemma dodatno poudarja potrebo po jasnih pravilih glede odgovornosti razvijalcev in ponudnikov AI modelov. Evropska unija z nedavno sprejetim AI Act postavlja strožje okvirje, ki naj bi zmanjšali tveganja za uporabnike. V ZDA pa zakonodajalci, kot je senatorica Blackburn, krepijo politični pritisk na tehnološka podjetja, naj dosledno preprečujejo zlorabe svojih orodij.

Slovenski strokovnjaki ocenjujejo, da bo dogodek vplival tudi na evropski in slovenski razvoj umetne inteligence. Po mnenju dr. Marka Grobelnika z Instituta Jožef Stefan takšni incidenti povečujejo previdnost uporabnikov in regulatorjev, a hkrati spodbujajo razpravo o pravičnem in varnem razvoju AI orodij. Pravnik dr. Domen Savič opozarja, da bodo morala podjetja, ki uvajajo AI rešitve v Sloveniji, v prihodnje še bolj upoštevati odgovornost za generirane vsebine ter slediti smernicam evropskih regulatorjev. Dogodek z Gemmo tako postavlja nova vprašanja o prihodnosti odprtokodnih in komercialnih AI modelov v Sloveniji in širše po Evropi.